VALL-E 微軟開發的文字轉語音模型驚人的模擬能力,令人害怕的既視感

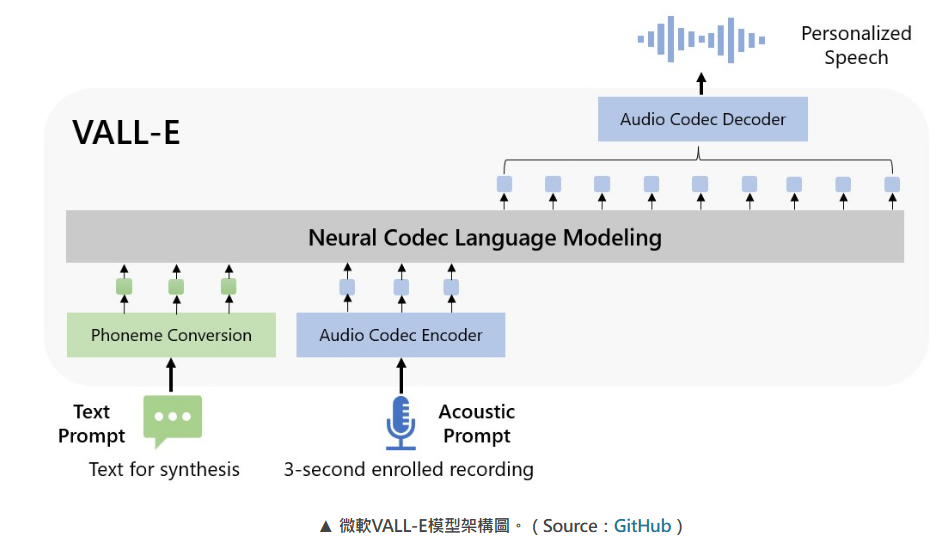

VALL-E 微軟開發的文字轉語音模型!可怕的是你只要給它3秒任何人的音訊,它即可模擬出聲音、語調甚至情緒並講出「任何話」。VALL-E 是「神經編碼解碼器語言模型」(Neural Codec Language Model),基於META辛宣布的Encode技術建立,它與一般透過操控聲音波形來合成語音的常見做法不同,VALL-E 從文字與聲音的「提示」產生個別音訊編碼解碼器,此新方式主要分析人如何發音,標記這些特徵,並記錄資訊分解成個別「token」元件,在此份研究論文中,開發者使用 LibriLight 音訊庫訓練,含 7 千多人約 6 萬小時說話內容。最終目前在範例網站展示,僅需3秒的語音檔,維妙維肖的模擬就如此輕而易舉的完成了!比DEEPFAKE更為可怕的工具就此誕生,往好處想它可以輕而易舉協助高品質文字轉語音應用開發、語音編輯及音訊內容創建…等,但誤入歧途」的 Deepfake仍記憶猶新,詐騙盛行的亞洲,詐騙集團也要開始進修AI了嗎?

PS:欲深入了解演算法做法可以參考資料來源3的paper

|

| 圖(一) 微軟VALL-E模型架構圖(來源VALL-E (valle-demo.github.io)) |

|

| 圖(二) 以分層方式構建的條件編解碼器語言建模的結構。在實踐中,NAR 解碼器將被調用七次以在七個量化器中生成代碼 |

|

| 圖(三)範例網站已有需多訓練好的成果展示 |

撰文:徐楷昕

資料來源:

3. Wang, Chengyi, et al. "Neural Codec Language Models are Zero-Shot Text to Speech Synthesizers." arXiv preprint arXiv:2301.02111 (2023)

留言

張貼留言