一言不合就GAN一下~用AI幫助AI提升準確率

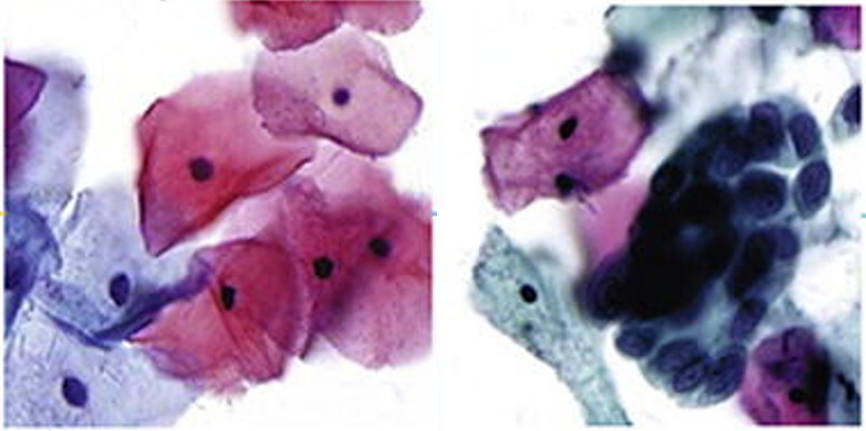

電腦視覺領域中,時常借助AI進行自動化的影像辨識、物件切割等等。模型通常需要經過大量的訓練才能完成,但若對於截然不同的風格影像,模型的泛化能力有負面的影像,舉例來說細胞病理學的圖像透過不同的顯微鏡拍攝下會有不同的色調差異(圖1)。

|

| 圖1 不同儀器拍攝的細胞病理圖,同種類的胞器是相同顏色,但是色調不一致 |

於是借助Generative Adversarial Network(生成對抗網路)的模型可以幫助我們對不同色調風格的影像進行標準化,先對影像標準化能夠幫助後續要使用的AI模型能有更準確的預測,因為輸入影像經過標準化的流程更貼近原本模型訓練集的類型。

Britton Chance Center for Biomedical Photonics 的研究團隊推出一個改良版本的GAN模型,能對細胞病理影像進行色調風格標準化,從圖2由左到右依序是來源圖像是我們所需的色調標準,目標圖像是其他儀器拍攝的不同色調圖片,訓練的流程是先將來源和目標圖像都進行灰階處理,接續將灰階圖片作為生成器(G)的輸入來源,生成器會隨機生成圖片,再透過D1 和D2鑑別器進行分辨是否風格和來源圖片是相同色調。

|

| 圖2 具有兩階段區域對抗風格標準化的框架,圖像風格標準化的過程 |

這邊D2和傳統的GAN鑑別器相同負責鑑識生成器產生的圖片是否和來源圖像相同風格,D1鑑別器較特殊,它會評估生成器是否嚴格的重建出色調、紋理、結構一致性(屬於強監督),它的Loss函數是逐個像素去計算,所以透過D1鑑別器可以確保生成器產生的圖片它的結構(邊界)細節能維持,僅改變色調。

生成對抗網路從2014被提出後就開始逐年增加相關研究與應用,目前在影視中看到黑白紀錄片彩色版或是藝術創作中自動生成3D模型或將文字生成插畫。透過AI幫助另一個AI模型的泛化性,期待更多AI模型相互交織而成的研究與應用出現。

撰文:許楷翊

參考文獻:

Chen, X., Yu, J., Cheng, S., Geng, X., Liu, S., Han, W., ... & Zeng, S. (2021). An unsupervised style normalization method for cytopathology images. Computational and Structural Biotechnology Journal, 19, 3852-3863.

留言

張貼留言