新型態神經網路 – LNN

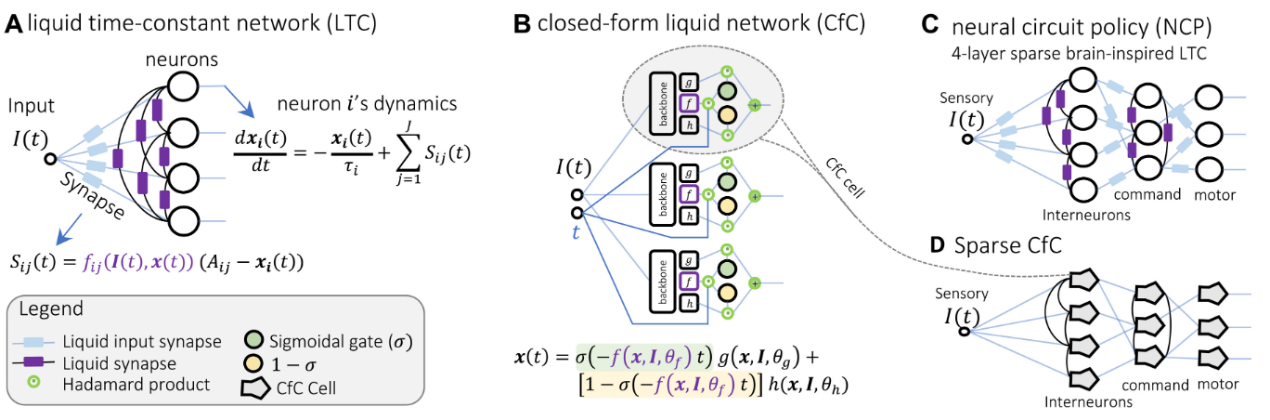

Liquid neural network(LNN)是一種靈活度高、能不受突然事件影響的連續時間網路;它具有很強的適應性,可以在接收大量數據後,通過改變其內部演算法來調整輸出,因此相比於傳統神經網路是利用改變神經元間,連接的權重去調整輸出一個固定值,LNN神經元間是一組非線性方程式,這代表輸入值的改變與輸出值的改變不一定成比例,例如輸入值翻倍,輸出值卻可能只有原本的1.5倍,而這個特性使其能夠很好地處理未曾見過的場景和混亂的資料(OOD),強大的適應力也是它被稱作「液態」的原因。(圖一)

|

| 圖一,LNN的架構,採用closed-form計算可以更快速的算出方程式的解,除了降低計算複雜度,也可以節省時間。 |

來自MIT的研究人員從微小的秀麗隱桿線蟲身上找到靈感,創造出了LNN,它的特性讓它可以比傳統神經網路更好地萃取出未經人工處理、無架構、無標記的高維特徵,研究人員認為它可以在無人機(UAV)追蹤目標的研究上發揮很好的表現,因此正執行相關實驗。

在訓練模型部分,研究人員將作為目標的紅色露營椅放置在樹林環境中,並控制UAV從10公尺外飛向目標,重複5次同樣步驟。蒐集完飛行畫面後,還進行了隨機調整畫面亮度、對比度、飽和度,以及裁切畫面等一系列的資料處理,以供模型有更多的訓練資料。(圖二)

|

| 圖二,(左)UAV的訓練示意圖。(右)UAV在訓練時,拍攝的畫面資料。 |

模型訓練結束後,研究人員便對其進行了四大項測試,並將結果和其他最新模型,包括LSTM、GRU-ODE、ODE-RNN以及TCN進行比較。測試項目包括:

1. 飛向定點目標:研究人員將紅色露營椅放置在不同背景環境下,測試UAV是否能從10公尺外,飛到並停在目標前。(圖三)展示四種不同的測試場景,(表一)為各模型進行於各種場景下之測試結果。另外,研究人員也測試了讓UAV從20公尺或30公尺外飛向目標。在20公尺時,只有CfC模型有90%的高成功率;而在30公尺時,全體模型的成功率皆未能超過20%。(NPC及CfC為使用LNN的模型)

|

| 圖三,測試場景分為四種,(左上)訓練時的樹林、(右上)其他樹林、(左下)都市草坪、 (右下)都市露臺。 |

|

| 表一,各模型進行於各種場景下,飛向定點目標之測試成功率,可看出CfC模型不管在哪個場景都有很好的表現。 |

2. 畫面干擾:研究人員將畫面隨機加入噪點,或改變亮度、或改變對比度、或改變飽和度來觀察UAV偏離目標的距離,而CfC有著最好的表現。除此之外,在畫面中加入一些干擾物體,例如旋轉物體並用布幕蓋住部分目標,或者是將目標擺在反光玻璃窗旁,NCP在抗反光玻璃的表現最好,在布幕遮蓋表現也不差,而CfC則是在布幕遮蓋的表現最好,有70%的成功率。

3. 連續飛向多目標:這裡是測試UAV是否能連續飛向下一個目標,並不受其他椅子干擾。相較於其他模型,CfC有最好的表現。另外,研究人員也將三個相同的目標分別擺在距離彼此10到25公尺的位置,形成正三角形,並設定UAV在飛到目標後,旋轉120度,讓它可以飛往下一個目標。研究人員選擇使用CfC模型,並在其成功操控UAV飛行4圈後停止實驗。(圖四)(圖五)

|

| 圖四,本測試場地與設定之空拍圖。 |

|

| 圖五,(A)本測試之示意圖及(B)UAV於測試時,拍攝之畫面。 |

4. 跟蹤目標:最後,研究人員將追蹤目標設定為紅色書包,並背著它在都市環境或草坪中走動,測試UAV是否能跟在身後飛行。由表二可看出不管是在都市或草坪,NCP與CfC模型皆有較長之平均跟隨距離。而在成功率部分,大部分的模型在都市環境皆有好表現,而在草坪上只有CfC模型能交出70%的成功率。

|

| 圖六,本測試之側拍圖,UAV會跟隨在人員身後。https://www.youtube.com/watch?v=RPFbk6D_dNw |

|

| 表二,本測試之各模型跟隨的平均距離(Mean)與成功率(Runs) |

研究人員利用LNN創造了一個強大的飛行導航系統,並成功完成以視覺為基礎的飛向目標任務,並且可以在沒有訓練過、截然不同的環境中成功執行;足以證明LNN的適應力強大,超過同期其它模型,且非常適合應對OOD任務。

撰稿者: 高振翔

Reference:

Chahine, M., Hasani, R., Kao, P., Ray, A., Shubert, R., Lechner, M., ... & Rus, D. (2023). Robust flight navigation out of distribution with liquid neural networks. Science Robotics, 8(77), eadc8892.

留言

張貼留言