Wifi 網路看世界

隨著計算機視覺與機器學習的蓬勃發展,RGB相機、光學雷達與雷達在2D/3D 的人體姿態辨識有重大的突破。然而他們卻有各自的缺點,RGB相機的使用會受到遮蔽物與光線的影響;光達與雷達則非常昂貴與耗電。為了排除原有方法的各自缺點,來自卡內基美隆大學(CMU)的研究者使用WiFi訊號與深度學習實現了遮擋、多人場景中的密集人體姿態估計。

#設備

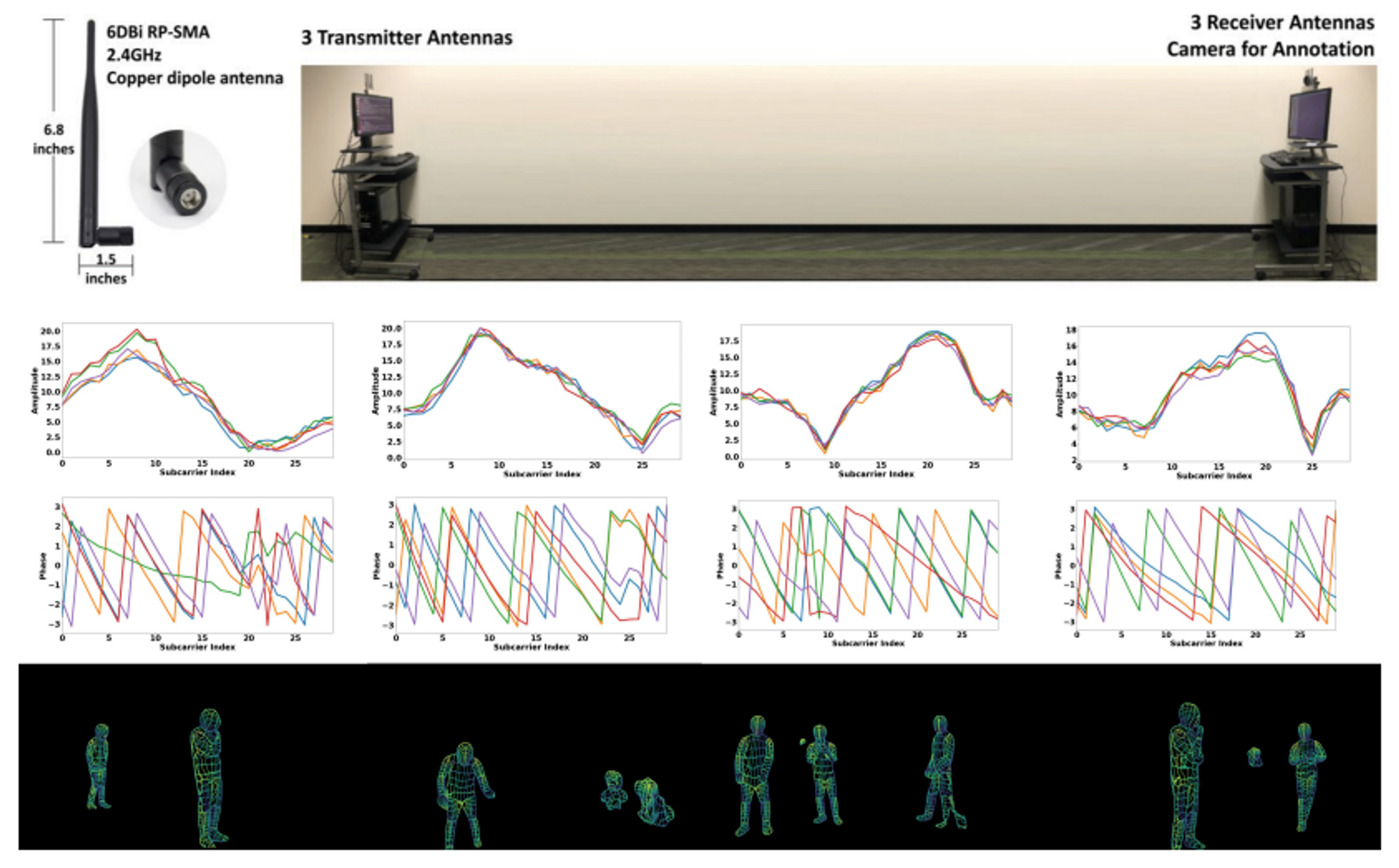

所需的設備只需要兩組具有三根天線的WiFi路由器(圖一 第一列),分別用來當作訊號發射器和對應的接收器。(圖一 第二三列) WiFi訊號的振福與相位。使用WiFi訊號估計的人體姿態(圖一 第四列)。

|

| 圖一 |

#方法

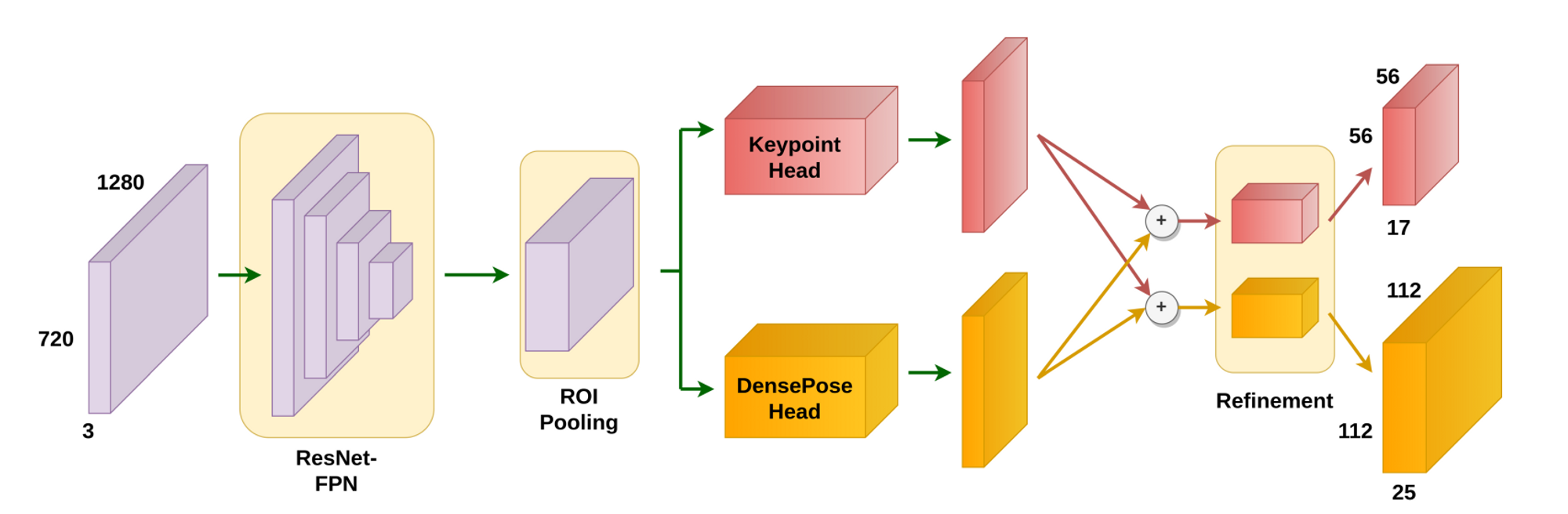

主要有三個步驟。首先會將WiFi訊號的發射與接收訊號繪製成3X3的 Channel-state-information (CSI) tensor (圖二)。接著使用 Modality Translation Network 將 CSI 訊號轉換成 3x720x1280的特徵圖 (圖三)。最後,使用 WiFi-DensePose RCNN 將3x720x1280的特徵圖傳換成refinement 單元。refinement 單元包含17x56x56 keypoint mask 與 25×112×112 IUV map。

|

| 圖二 CSI tensor |

|

| 圖三 Modality Translation Network |

|

| 圖四 WiFi-DensePose RCNN |

#結果

使用 WiFi 進行人體姿態辨識(圖五),能解決成本與遮蔽物的缺點。軀幹的姿態能有效的辨識 AP@50值為87.2;然而四肢的準確度有偏差AP@75為35.6。未來此項技術可應用在居家照護與室內保全。

|

| 圖五 |

撰文:謝明儒

參考資料

1. Geng, J., Huang, D., & De la Torre, F. (2022). DensePose From WiFi. arXiv preprint arXiv:2301.00250.ISO 690

留言

張貼留言